ローカルLLM(自分専用生成AI)はいかが?(2:環境編)

くまごろう

2025/7/9

2025/7/10

Mac対応ローカルLLM環境

Macで利用可能なローカルLLM環境を調べてみました。Model Context Protocol(MCP)で外部ツールとつないでみたいのでMCPサーバーに接続できるかも調べてみました。

1. Ollama

ローカルでLLaMAやQwenなどを動作可能。MCP経由の連携にも利用されることがあります。

コマンドラインで使うタイプのソフトですね。

2. GPT4All

Mシリーズチップ搭載Macでも動く小型LLM。完全オフラインで動作 。

ただしデフォルトでMCP対応ではないため、別途MCPクライアントとの橋渡しが必要になります。

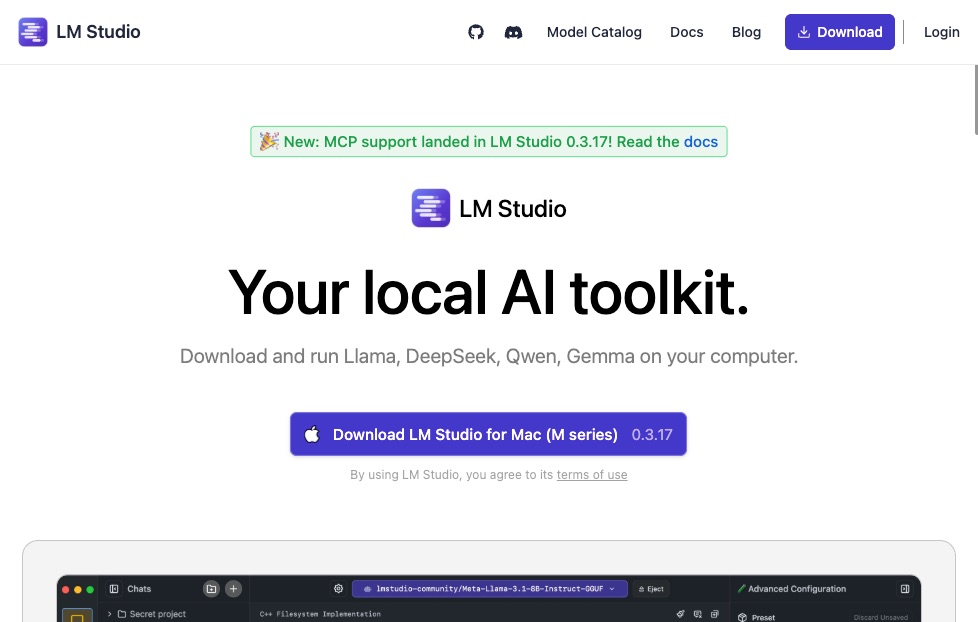

3. LM Studio

バージョン0.3.17以降でMCPクライアント機能を内蔵しており、自分で mcp.json を編集するかUIから追加すればMCPサーバーと連携できます。

今回試すのはLM Studio!

Ollamaも魅力的なのですが、MCPサーバーとの連携が簡単そうなので LM Studioを使ってMacでローカルLLMを試します。モデルは、Gemma 3n あたりから試せたらなと考えています!

さっそくインストール

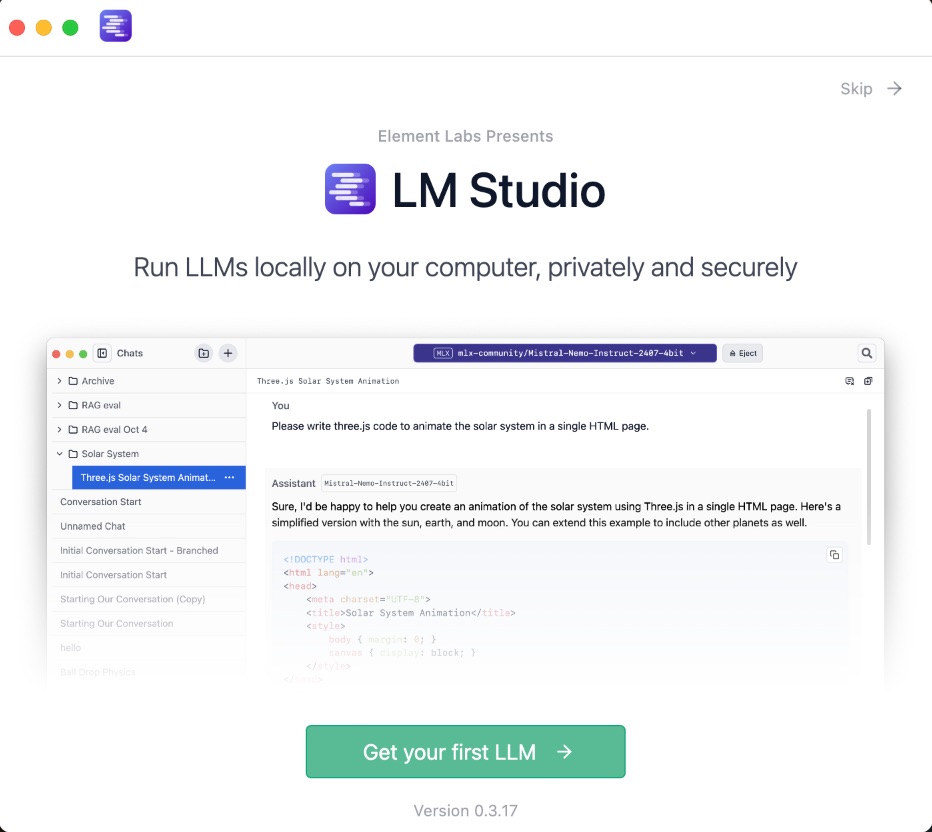

インストールは簡単、LM Studio のWebサイト(https://lmstudio.ai)からインストーラーをダウンロードしてインストールするだけ!

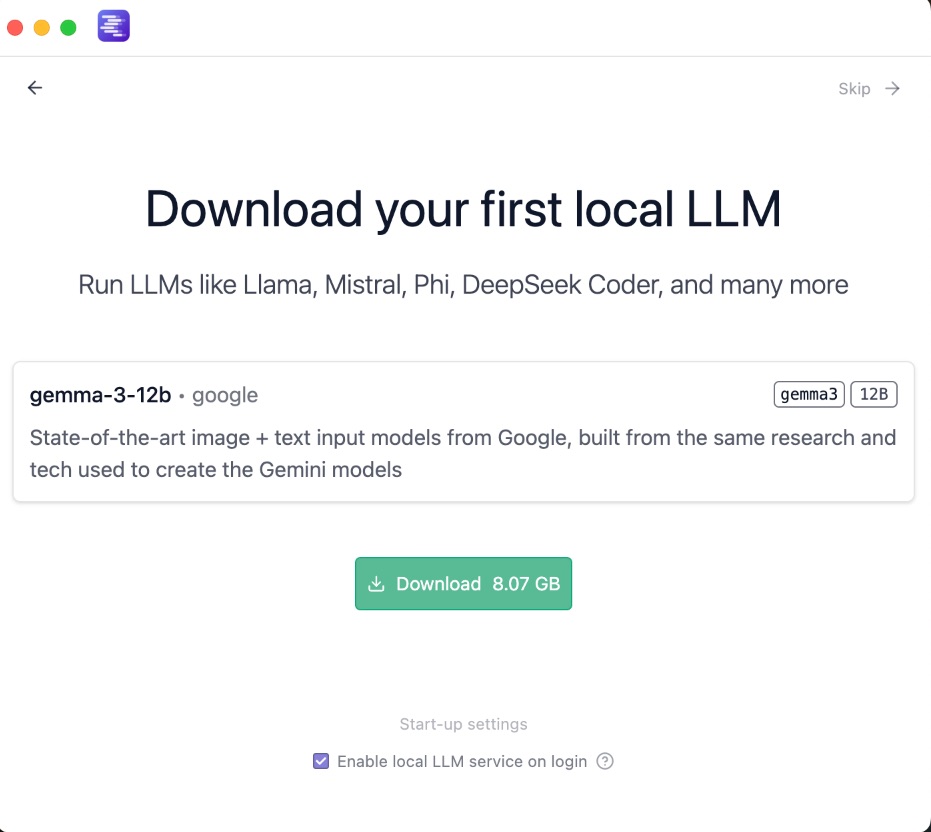

起動すると最初に使うモデルをダウンロードするかなどを聞いてきました。Gemma 3nが使いたいのですが、選択する余地がなさそうなので、とりあえずそのまま続行。

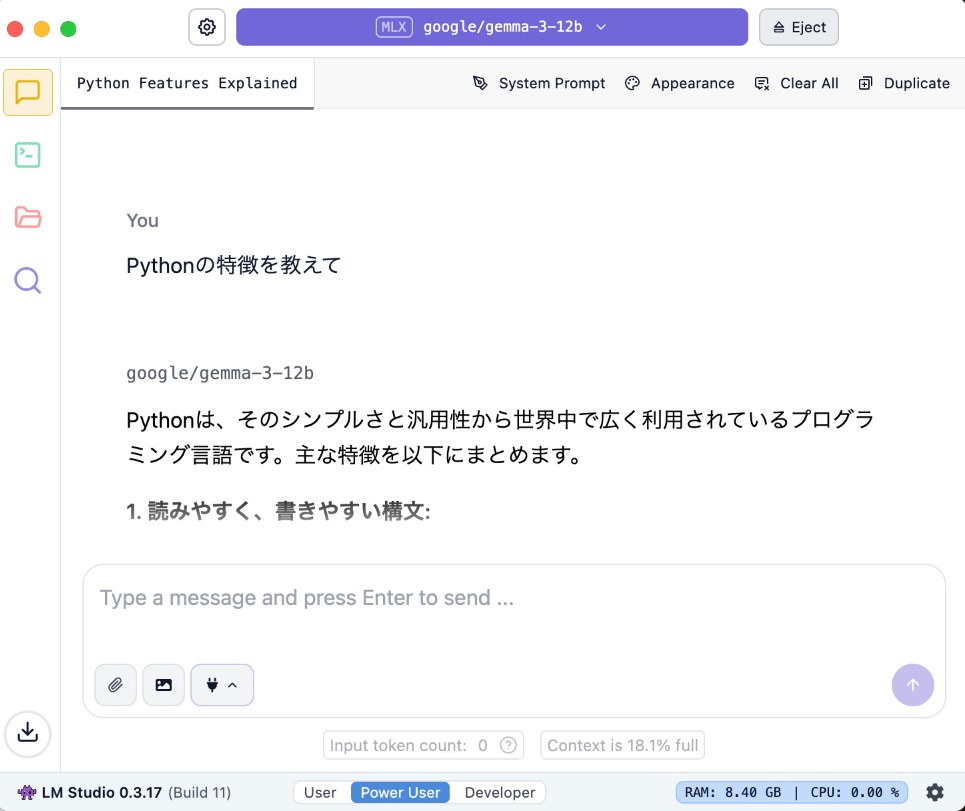

早速、試しにPythonについて聞いてみました。遅すぎるわけでもなく、けっこう普通に使えています!!

次回は、モデルをGemma 3nに変更してみたいと思います。

コメント

コメントはまだありません。